Pasażerowie warszawskiej komunikacji miejskiej przynajmniej raz mogli natrafić na reklamę aplikacji HomeGirl — która, zgodnie z zapewnieniami jej twórczyń, ma zapewniać bezpieczeństwo kobietom poprzez udzielenie przestrzeni do wzajemnej komunikacji między użytkowniczkami aplikacji.

I tutaj inicjatywę muszę pochwalić — ponieważ przynajmniej w przeszłości nagłówki wielu polskich portali dotyczyły np. przypadków gwałtów na pasażerkach taksówek zamawianych w popularnych aplikacjach, a pomoc w postaci choćby porozmawiania przez telefon mogłaby nawet uratować przed wystąpieniem takiej sytuacji.

Może i HomeGirl nie jest aplikacją adresowaną do przedstawicieli mojej płci — ale gdy wchodzą w grę hasła promocyjne typu „bezpieczeństwo”, to takie argumenty należy poddać stosownej weryfikacji. Ponieważ bezpieczeństwo powinno być zapewniane względem wszystkich zagrożeń, włącznie z tymi cyfrowymi.

💡 Podpowiedź

Artykuł oparty jest wyłącznie na aplikacji w wersji na Androida. Z uwagi na brak posiadanego przeze mnie jakiegokolwiek sprzętu z „nadgryzionym jabłkiem na tyłach”, nie byłem w stanie zweryfikować, czy podobne rzeczy mają miejsce także w aplikacji na iOSa.

Co oferuje aplikacja?

Na stronie głównej możemy przeczytać, że w aplikacji możemy porozmawiać z innymi użytkowniczkami HomeGirl, zadzwonić w razie potrzeby na numer alarmowy, czy też wyznaczyć trasę do domu z ominięciem punktów wskazujących potencjalne zagrożenia. Możemy też z poziomu aplikacji zadzwonić na „antyprzemocową linię” zarządzaną przez organizację SEXED.

Od strony koncepcji, aplikacji nie da się niczego negatywnego zarzucić — bo każdy/każda ma prawo do bezpieczeństwa, w szczególności będąc w podróży.

Ale to, co znajduje się w jej kodzie, oraz to, jak obowiązek informacyjny narzucany przez RODO (nie) jest spełniany — już tak.

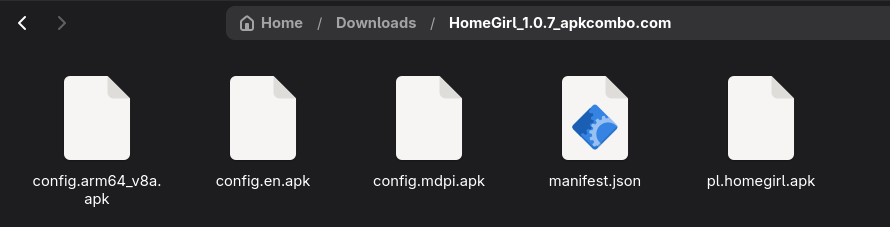

Mając wstęp za sobą, przystępuję do pobrania pliku XAPK (taki był w stanie zaoferować mi serwis ApkCombo).

Plik manifest.json

Jest to coś na wzór pliku AndroidManifest.xml, który doskonale znają twórcy aplikacji na Androida. Zgodnie z dokumentacją programistyczną, plik ten odpowiada za zdefiniowanie:

- listy komponentów oraz ekranów wykorzystywanych w aplikacji;

- listy potrzebnych uprawnień do prawidłowego jej funkcjonowania;

- listy wymaganych komponentów sprzętowych, co może wpływać na kompatybilność aplikacji w szczególności ze starszymi sprzętami.

Ponieważ mamy do czynienia wyłącznie z plikiem manifest.json, jest to co prawda okrojona wersja wyżej wskazanego AndroidManifest.xml (nie znalazłem w pliku JSON np. informacji o konkretnych ekranach dostępnych w aplikacji), ale wystarczająca do choćby określenia tego, z jakich np. uprawnień aplikacja będzie chciała skorzystać.

Innymi słowy, są to wyłącznie metadane aplikacji, które są jawne w choćby Google Play Store (oczywiście wcześniej przetworzone w taki sposób, żeby były czytelne dla każdego).

Patrząc na zawartość tablicy permissions, moją szczególną uwagę przykuł jeden wpis — com.google.android.gms.permission.AD_ID.

Zaraz, co? Czy na pewno pobrałem właściwą aplikację?

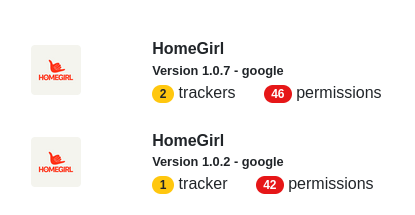

Okazuje się, że Exodus Privacy również doszukał się tego uprawnienia. Co więcej, w wersji 1.0.2 — która również została przeanalizowana tym narzędziem — takiego jeszcze nie było (najnowszą w chwili pisania tekstu jest wersja 1.0.7).

Szybkie wyszukiwanie potwierdziło moje obawy — oficjalna strona pomocy od Google’a wskazuje, że uprawnienie o nazwie com.google.android.gms.permission.AD_ID odpowiada za dostęp do identyfikatora reklamowego.

Można odnieść wrażenie, że aplikacja — mimo iż chroni przed zagrożeniami w realnym świecie — nie zapewnia równie wysokiego poziomu ochrony prywatności w kontekście danych reklamowych.

To prowadzi z kolei do bardziej otwartego pytania o to, jak dane użytkowników mogą zostać wykorzystane w sposób, którego mogą nie być świadomi.

Czemu?

W 2012 roku — kiedy to obecna sytuacja w internecie, nie tylko w Polsce, ale też w reszcie świata, dopiero raczkowała — było dość głośno o amerykańskiej sieci sklepów Target, która stosowała różne techniki do uprawdopodobnienia, która część klientów mogła być w ciąży.

Osoby, wobec których podejrzewano zajście w ciążę, otrzymywały kupony zniżkowe na rzeczy związane z ciążą oraz pierwszymi dniami życia potomstwa.

Skąd takie rzeczy można było wywnioskować? Działo się to na podstawie list zakupów. I tak, dla przykładu gdy jeden z potencjalnych klientów (lub bardziej konkretnie, klientek) Targeta kupuje suplementy uzupełniające witaminy czy minerały, w przypadku jednego ze scenariuszy szansę na to, że taka osoba może być już w ciąży, wyliczono w tamtym czasie na 87%.

W jednej sytuacji doszło nawet do tego, że jeden z ojców nastoletnich córek pokłócił się z kierownikiem jednego z Targetów o te kupony — co doprowadziło do tego, że kierownik przeprosił ojca za zaistniałą sytuację.

Choć miało to miejsce 6 lat temu przed wdrożeniem w życie RODO w Europie, podobna sytuacja prawie 14 lat później by była obarczona restrykcyjnymi sankcjami, przynajmniej gdyby miało to miejsce w kraju członkowskim Unii Europejskiej.

Oczywiście mówię o tym czysto teoretycznie, bo rzeczywistość jest zgoła inna.

Pobieżna analiza polityki prywatności

Postanowiłem się zagłębić w inne aspekty prawno-techniczne aplikacji. Standardowo, sprawdźmy, jakie zapisy kryją się w polityce prywatności i rozbierzmy je na czynniki pierwsze.

Przykładowo, w rozdziale 3., który opisuje zakres zbieranych danych, możemy się dowiedzieć, że aplikacja przetwarza:

- dane lokalizacyjne, które potem można wykorzystać do dodania poszczególnych punktów opisujących potencjalne zagrożenia, przy czym jesteśmy zapewniani, że „te punkty nie są przechowywane na serwerach” (nie podaje jednak konkretnej metody, jak agregowane dane są potem udostępniane innym użytkowniczkom HomeGirl);

- dane techniczne urządzenia, takie jak adres IP, typ urządzenia i wersja systemu operacyjnego, używane wyłącznie w celach diagnostycznych i bezpieczeństwa;

- treści rozmów czatowych, które mogą być tymczasowo przechowywane do 1 godziny od momentu rozpoczęcia rozmowy, wyłącznie w celu umożliwienia wznowienia połączenia, przy czym po umownych 60 minutach konwersacje mają potem być „trwale usuwane”;

- informacje o tym, że miało miejsce poszczególne połączenie, przy czym nie są zapisywane transkrypcje czy nagrania z rozmów głosowych (ale tutaj retencja trwa 30 dni).

Na plus możemy zaliczyć podanie konkretnych okresów retencji danych — coś, z czym nie miałem się okazji wbrew pozorom często spotykać, czytając polityki prywatności różnych serwisów internetowych.

Naturalną koleją rzeczy jest zadanie pytania, jak aplikacja się takimi danymi posługuje. Czy w aplikacji konwersacje są jakkolwiek szyfrowane? Jeżeli tak, to jakim protokołem? Czy jest to Signal Protocol (który swoją drogą uznawany jest za „złoty standard” szyfrowanej komunikacji), czy własna implementacja (której wdrożenie w takich aplikacjach powinno być bardzo dobrze przemyślane)?

I najważniejsze — czy „usunięte” rzeczywiście znaczy słynne „nie mamy pańskiego płaszcza, i co pan nam zrobi”?

Zadałem siedem pytań (listę możesz rozwinąć poniżej), które są związane z m.in. tematyką aplikacji, ale też niektóre zasugerowały skorzystanie w miarę możliwości z otwartoźródłowych zamienników.

Rozwiń listę pytań

- Jak wygląda proces weryfikacji tego, że ktoś jest faktycznie daną osobą, za którą się podaje? Czy stosowane są jakiekolwiek zautomatyzowane procesy mające na celu ewentualne usprawnienie takich procedur?

- Dlaczego w pliku manifestu aplikacji zostało zadeklarowane uprawnienie com.google.android.gms.permission.AD_ID? Do jakich celów aplikacja pozyskuje identyfikator reklamowy, tym bardziej, że przynajmniej teoretycznie w ten sposób korporacje reklamowe są w stanie wyśledzić korzystające z aplikacji kobiety, która jest reklamowana jako „zapewniająca bezpieczeństwo”?

- Czy konwersacje przeprowadzane w aplikacji są jakkolwiek szyfrowane? Czy stosowana jest wyłącznie metoda „in-transit” (dane są zabezpieczone wyłącznie na czas transferu), czy dane są szyfrowane także na samych serwerach („at rest”)? Jeżeli szyfrowanie konwersacji się odbywa, to jaki protokół jest do tego wykorzystywany (mowa tutaj o protokołach takich jak np. Signal Protocol, uznawany za standard szyfrowanych komunikacji)?

- Czy konwersacje mogą być śledzone przez twórców aplikacji?

- Odnośnie punktu polityki prywatności brzmiącego „adres e-mail — uzyskany w procesie logowania za pomocą Google lub Apple”, czy osoby nieposiadające konta Google/Apple będą również mogły skorzystać z takiej aplikacji (zakładając, że posiada skrzynkę e-mailową na np. ProtonMailu)? Jak zachowuje się aplikacja w przypadku, gdy na telefonie z Androidem nie ma zainstalowanego modułu Google Mobile Services?

- Jakie inne skrypty śledzące są zainstalowane w aplikacji „HomeGirl”? Jeżeli one w ogóle występują, to dlaczego nie została sprecyzowana odpowiednia informacja na ten temat, z wyjątkiem lakonicznego fragmentu „analizy działania i rozwoju funkcji aplikacji”, co może sugerować ich zastosowanie (jednak nie podano, które podmioty zewnętrzne konkretnie otrzymują dane)? Czy istnieje możliwość, żeby w jakiejkolwiek przyszłej wersji aplikacji zostały one usunięte?

- Czy zamiast widżetu Google Maps istnieje możliwość, żeby w aplikacji użyto widżetu opartego o OpenStreetMap?

Samodzielna weryfikacja, jak funkcjonuje aplikacja, jest dla mnie niemożliwa z trzech powodów.

Pierwszy powód — mam w dowodzie literę „M” (więc pozostaje mi oddelegowanie tego do jakiejkolwiek mojej przyjaciółki, lub powołanie się na komentarz od strony reprezentantek aplikacji). Drugi powód — aplikacja się blokuje bez zainstalowanego modułu Google Mobile Services (testowałem zarówno na moim głównym Samsungu oraz starszej Motoroli z zainstalowanym LineageOS 18.1 — oba te telefony nie mają wspomnianego GMS). Trzeci powód — ponieważ nie ma gdziekolwiek dostępnego kodu źródłowego, aplikację musiałbym zdekompilować, a nie wiem, jak zareagowałyby na to twórczynie (i zważając na ograniczone fundusze w „Kontrabandzie”, nie chciałbym ryzykować otrzymania nazajutrz pozwu).

Twórczynie aplikacji (fundacja „IT Girls”) nie udzieliły mi na czas publikacji artykułu odpowiedzi (pytania wysłałem 5 października 2025 roku). Niniejszy artykuł zaktualizuję, gdy taką otrzymam.

Źródła

Zdjęcie tytułowe zostało oparte o logotyp aplikacji HomeGirl. Treść artykułu powstała na podstawie źródeł własnych, z wyjątkiem sekcji o amerykańskiej sieci sklepów Target, gdzie powołano się na następujące źródła zewnętrzne:

- How Target Figured Out A Teen Girl Was Pregnant Before Her Father Did, opublikowany w serwisie forbes.com w dniu 16.02.2012 przez Kashmir Hill